Uno de los supercomputadores más avanzados de Europa está en Barcelona. Una máquina así merece estar alojada en un lugar especial, y MareNostrum 4 lo está. Al igual que sus predecesores reside en la preciosa capilla de Torre Girona, un emplazamiento único con más de un siglo y medio de antigüedad que contrasta con la sofisticación de los equipos que acoge en su interior.

MareNostrum 5, el grupo de supercomputadores que recogerá el testigo de MareNostrum 4, está siendo construido y estará listo completamente no más allá de finales de 2022, aunque su considerable volumen ha provocado que sus dominios se extiendan más allá de las paredes de la capilla que ha acogido a sus predecesores. Eso sí, cuando esté preparado será una auténtica bestia de hasta 200 petaflops capaz de propulsar cientos de proyectos científicos y de ingeniería.

Mateo Valero es catedrático de Arquitectura de Computadores en la Universidad Politécnica de Cataluña y director del BSC (‘Barcelona Supercomputing Center’)

Para hablar de todo esto, y de muchas otras cosas interesantes, nos hemos puesto en contacto con Mateo Valero, catedrático de Arquitectura de Computadores en la Universidad Politécnica de Cataluña y director del BSC (Barcelona Supercomputing Center). Su currículo está repleto de galardones en el área de la arquitectura de computadores, como el premio Seymour Cray (2015) o el Charles Babbage (2017), entre otros, lo que avala su actividad investigadora.

También tiene los premios nacionales de investigación Julio Rey Pastor y Leonardo Torres Quevedo, así como nueve doctorados honoris causa, entre otras distinciones. Pero lo más llamativo es que basta hablar unos minutos con él para darse cuenta de que su gran responsabilidad al frente del BSC no ha mermado un ápice su vocación didáctica.

Un apunte más antes de meternos en harina: si os apetece leer el último libro en el que ha participado Mateo, titulado ‘Faster than the future. Facing the digital age’, podéis descargarlo gratuitamente desde este enlace.

El BSC es un instrumento al servicio de la ciencia y la ingeniería

¿Cómo nació el BSC? ¿Cuál es su historia y cómo ha alcanzado el estatus que tiene actualmente?

El BSC nació en 1984. Ese año convencí a los gobiernos de España y Cataluña de lo enormemente prometedor que era el paralelismo en computación utilizando muchos procesadores. Yo era catedrático (gané la cátedra en 1983), y mi grupo empezaba a trabajar en esta área, por lo que pensé que sería bueno crear un centro especializado en supercomputación.

En 1985 el titular del Ministerio de Industria era Joan Majó, y recuerdo que me dio los primeros diez millones de pesetas para comprar una máquina que tenía 64 procesadores. Poco a poco fuimos consiguiendo un poco más de dinero para nuevas máquinas y nos esforzábamos para hacer mucha transferencia de tecnología con el propósito de crecer y poder contratar más personal.

Hasta que en 2004 los mismos patronos que habían colaborado con nosotros durante los últimos veinte años deciden promocionarnos a la primera división, consolidando así el Centro de Supercomputación Nacional. Esta es la pequeña historia del BSC. Afortunadamente el Gobierno el año pasado firmó para darnos estabilidad presupuestaria durante nueve años más.

¿Cuáles son las características más relevantes de los equipos que se utilizan actualmente en los centros de supercomputación? ¿Qué los hace tan capaces?

La supercomputación es la ciencia que se hace con los supercomputadores, que son los ordenadores más rápidos del mundo. Para construirlos hacemos que muchos procesadores que por sí mismos son muy potentes trabajen conjuntamente. El supercomputador más rápido del mundo tiene más de diez millones de procesadores, cada uno con su memoria, que suele ser entre 1 y 2 GB por procesador, dando forma a una memoria central muy grande y con una potencia de cálculo enorme.

«La red de interconexión de los procesadores tiene una latencia cien veces menor que el 5G y un ancho de banda cien veces mayor que el de esta tecnología»

Una característica fundamental de los supercomputadores es que sus procesadores se comunican a una velocidad muy alta a través de una red de interconexión que normalmente es de fibra óptica. Los diez millones de procesadores que tiene el supercomputador más rápido del mundo son muchos, pero en España, en nuestras casas, tenemos más de diez millones de procesadores. Aun así, no podemos hacer lo mismo.

La diferencia es la red de interconexión, que tiene dos características esenciales: una latencia cien veces menor que la de las comunicaciones 5G y un ancho de banda cien veces mayor que el de esta tecnología. Este hardware requiere tener una gran capacidad de almacenamiento en disco debido al enorme volumen de datos que nos entregan los programas, por lo que también es esencial maximizar la velocidad a la que puedes llevarlos desde la memoria central a los discos, y al revés.

Mateo Valero, el director del Barcelona Supercomputing Center, es doctor ‘honoris causa’ por nueve universidades y miembro de nueve academias científicas.

Mateo Valero, el director del Barcelona Supercomputing Center, es doctor ‘honoris causa’ por nueve universidades y miembro de nueve academias científicas.

¿Cuál es el rol del BSC? ¿Qué compromiso han adquirido con la sociedad las instituciones que se dedican a la supercomputación?

Nuestro centro tiene dos funciones. La primera, al tratarse de una gran instalación dotada de grandes máquinas, consiste en dar servicio público a cualquier investigador español o europeo. Y la segunda, dada nuestra entidad como centro de investigación, es producir ideas que nos permitan obtener dinero de empresas y proyectos europeos para avanzar.

MareNostrum 5, el próximo supercomputador del BSC, será híbrido y tendrá una potencia máxima de 200 petaflops. Es tan voluminoso que no cabe al completo dentro de la capilla de Torre Girona

Hemos pasado de las 60 personas que éramos en 2005 a las 725 que somos hoy, aunque solamente hay 14 funcionarios, entre los cuales estoy yo. Si hemos crecido es gracias a la labor de todas las personas que trabajan conmigo. Un dato importante es que nosotros utilizamos menos del 10% de los supercomputadores. El resto es utilizado por cualquier grupo de investigación español o europeo después de pasar evaluaciones muy exigentes.

Nosotros no evaluamos. Y, por supuesto, todos los proyectos tienen que superar también controles muy fuertes desde un punto de vista ético. Entre las 725 personas que forman parte del BSC hay más de 600 investigadores organizados en cuatro departamentos: ciencias de los computadores, ingeniería, cambio climático y ciencias de la vida. En definitiva, el BSC es un instrumento más al servicio de la ciencia y la ingeniería.

En ese caso veo que es importante que las personas que trabajan en el BSC tengan un perfil multidisciplinar…

Exactamente. Hay unas 25 carreras, y la mayoría de nuestros proyectos son multidisciplinares. Por ejemplo, en medicina personalizada trabajan juntos ingenieros, matemáticos, físicos, biólogos, químicos y médicos. Y en nuestro proyecto de búsqueda de petróleo en ambientes hostiles colaboran geólogos, ingenieros de telecomunicaciones, ingenieros en informática, matemáticos, físicos… La interdisciplinariedad y la colaboración son la base de la investigación.

RISC-V es la gran esperanza de Europa para independizarse del hardware estadounidense

¿Qué tipos de procesadores utilizáis en los supercomputadores del BSC? ¿Y qué sistema operativo usáis para cohesionar toda la infraestructura?

Normalmente los supercomputadores incorporan o un único tipo de procesadores, o dos tipos de CPU. La primera categoría son los procesadores de propósito general, como los de Intel o AMD con los que todos estamos familiarizados. Estos procesadores comen de todo: carne, pescado, verdura… Pero hay otro tipo de procesadores a los que como les des carne, la devoran.

«Desde que pusimos a punto MareNostrum 4 en vez de dedicar todo el dinero a un computador decidimos invertirlo en varias máquinas distintas»

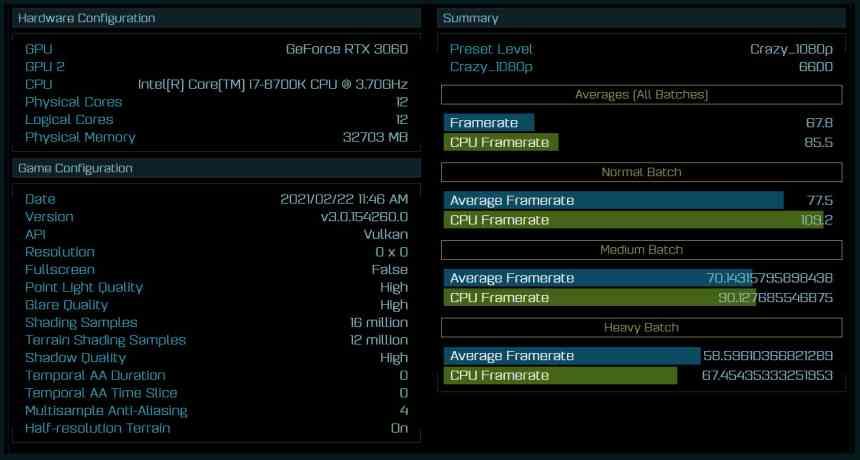

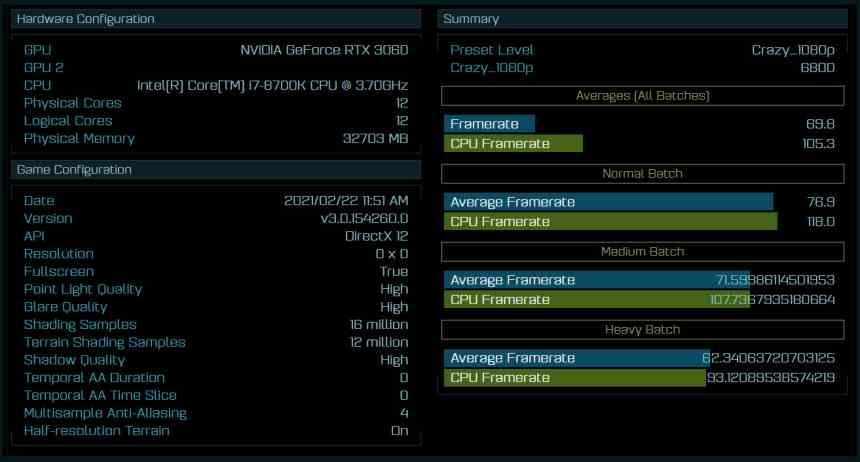

El test Linpack, que es uno de los más importantes que se utilizan para evaluar la potencia de los superordenadores, es rico en carne, y aquí los procesadores gráficos de NVIDIA tienen un rendimiento muy superior al de los chips de propósito general porque devoran la carne. En nuestra metáfora la carne son las operaciones matriciales que tan bien se les dan a las GPU.

Nosotros tenemos un presupuesto económico, otro de espacio, y un tercero de energía. Si quieres pasar el test de la manera más rápida porque quieres estar en la cima de la clasificación tienes que comprar computadores que tengan esos aceleradores. El problema es que son buenos para comer carne, pero no para comer pescado ni verdura, por lo que desde que pusimos a punto MareNostrum 4 en vez de dedicar todo el dinero a un computador decidimos invertirlo en varias máquinas distintas.

Los supercomputadores MareNostrum 4 del BSC están emplazados en una ubicación con mucho encanto: la capilla de Torre Girona, alojada en un edificio histórico construido en 1860.

Los supercomputadores MareNostrum 4 del BSC están emplazados en una ubicación con mucho encanto: la capilla de Torre Girona, alojada en un edificio histórico construido en 1860.

El propósito de esta estrategia es tener supercomputadores que sean capaces de optimizar la ejecución de un abanico amplio de aplicaciones. Y esto tiene un lado bueno y otro malo. El bueno es que tenemos un menor tiempo de cálculo y consumimos menos energía, y el malo es que nos dicen «no estáis muy bien cuando no estáis los primeros». Lo que pasa es que si sumas la velocidad de los cuatro estás mucho mejor que si solo apareces en la clasificación con uno.

MareNostrum 4 son cuatro supercomputadores con todo tipo de procesadores: Intel, AMD, ARM, PowerPC de IBM, NVIDIA… Uno es de propósito general y está formado por máquinas de Lenovo con procesadores Intel. Tenemos otro de IBM con procesadores gráficos de NVIDIA que está especializado en inteligencia artificial. También tenemos uno más pequeño que tiene una arquitectura parecida a la de Fugaku, que es el superordenador más rápido actualmente, con ARM. Y, por último, tenemos otro con procesadores AMD y aceleradores también de AMD.

«MareNostrum 4 son cuatro supercomputadores con todo tipo de procesadores: Intel, AMD, ARM, PowerPC de IBM, NVIDIA…»

Si con MareNostrum 5 nos proponemos batir el récord del TOP500 podríamos quedar en estos momentos entre los tres primeros del mundo, pero no es nuestro objetivo. Cuando optas por la diversidad tienes que distribuir el dinero, y a la hora de superar el test cada supercomputador va por libre.

Hasta el año 2004 cada fabricante de supercomputadores ponía su sistema operativo, por lo que las aplicaciones no eran compatibles. Era un caos. Nosotros nos arriesgamos y MareNostrum 1 fue el primer supercomputador commodity, y esto significa que el hardware no es especial como lo era en los anteriores, que eran dinosaurios. Podías ir a El Corte Inglés el viernes, comprar el material y montarte el mecano el fin de semana. El hardware era el mismo que utilizaban los ordenadores personales y no chips específicos como hasta entonces, que eran mucho más caros.

Y luego con el software tomamos la decisión de que fuese el primer supercomputador que iba a utilizar Linux. Ahora todos los supercomputadores usan este sistema operativo porque esto te garantiza la compatibilidad de la aplicación hacia abajo, pero lo que no es compatible en general es un hardware con otro. Lo que sucedió en aquel momento con Linux está pasando ahora con el hardware gracias a la arquitectura RISC-V. Nosotros estamos promocionando que Europa pueda desarrollar supercomputadores con hardware europeo.

¿Quieres en ese caso decir que la arquitectura RISC-V es la gran esperanza de los europeos para no tener esa dependencia que tenemos actualmente del hardware estadounidense?

Sí, así es. De hecho, el BSC es la institución que está moviendo todo esto en Europa, unas veces con problemas políticos, y otras con problemas económicos. En cualquier caso, la única opción que tiene Europa si quiere ser independiente en el ámbito de la supercomputación solamente pasa por desarrollar procesadores RISC-V. Y es una decisión política. No hay otra solución.

Los supercomputadores del futuro serán aún más heterogéneos

¿Cómo serán los supercomputadores en el futuro? ¿Mantendrán la heterogeneidad que, como nos estás explicando, tienen los actuales, o tendrán incluso un hardware más heterogéneo?

Vamos a hacer máquinas cada vez más heterogéneas y con una mayor variedad de procesadores, que estarán orientados a aplicaciones específicas. Por ejemplo, los procesadores neuromórficos serán el mejor hardware para simular el comportamiento del cerebro cuando, eso sí, sepamos con precisión cómo funciona una neurona, que es algo que aún no conocemos.

Todo el mundo está esperando también la computación cuántica, y creo que cuando llegue será un acelerador de algunos problemas determinados, como los de optimización. Nosotros trabajamos con un ordenador cuántico de dos cúbits para probar esta tecnología, pero se necesita mucho dinero, por lo que creo que en España no nos interesa aún meternos en este tema. Creo que lo que tenemos que hacer es desarrollar algoritmos cuánticos y patentarlos.

¿Qué tipo de proyectos están llevando a cabo los grupos de investigación que están utilizando los recursos de los supercomputadores del BSC?

Hasta ahora se han ejecutado más de 4000 proyectos, y todos ellos tienen un enorme valor añadido. Algunos de ellos no se podrían llevar a cabo sin esta capacidad de cálculo, y otros sí se podrían hacer. En cualquier caso algunas de nuestras principales áreas de investigación son la biomecánica, la predicción del clima, la bioinformática, la computación cognitiva, la genómica, la inteligencia artificial, la fusión nuclear o las simulaciones para proyectos de ingeniería, entre otras áreas.

¿Qué impacto tiene en el desarrollo científico europeo que los superordenadores más potentes sean japoneses, estadounidenses y chinos? ¿Tener estas máquinas les de una ventaja competitiva?

Los que realmente tienen la tecnología son los americanos, y lo que hacemos todos los demás es comprar computadores con ella. Por eso nosotros hemos puesto en marcha la iniciativa que debería permitir a Europa fabricar sus propios procesadores RISC-V. En lo que Europa es buena actualmente es en el desarrollo de software. De aplicaciones.

«Hay una máxima que me gusta mucho, y que dice: ‘El país que no computa, no compite’»

En cualquier caso, hay una máxima que me gusta mucho, y que dice: «El país que no computa, no compite». Y computar no significa solo tener los supercomputadores más rápidos del mundo; significa tener computadores de todo tipo que sean capaces de enfrentarse con garantías a problemas muy diversos.

El objetivo actual de los países europeos es dedicar más dinero a la compra de supercomputadores, pero también invertir más dinero en el desarrollo de nuestra propia tecnología. Cuantos más supercomputadores tengamos más gente podrá hacer investigación frontera, pero creo que se está mejorando el parque de supercomputadores europeos.

Los ordenadores cuánticos y neuromórficos encajan en los centros de supercomputación

Imagino un futuro en el que en los centros de supercomputación los ordenadores cuánticos y los procesadores neuromórficos convivirán con los superordenadores clásicos porque cada uno de ellos estará especializado en la resolución de un tipo de problemas determinado. ¿Estás de acuerdo con esta visión?

Absolutamente. Hoy para resolver todo lo que tiene que ver con la inteligencia artificial utilizamos los procesadores gráficos de NVIDIA, AMD, o los Ponte Vecchio de Intel. Y si quieres hacer una simulación del cerebro puedes utilizar el hardware que tienes, pero si empleas un procesador neuromórfico ese software se va a ejecutar mucho más rápido. Los procesadores neuromórficos ya se están utilizando en algunas aplicaciones, como, por ejemplo, para reconocer imágenes.

Con los ordenadores cuánticos nos enfrentamos al reto de conseguir que los cúbits sean más estables, pero serán idóneos para resolver determinados tipos de problemas. De hecho, en Alemania y Francia ya se van a introducir los primeros ordenadores cuánticos en los centros de supercomputación como un procesador especializado más. Eso sí, una gran parte de la computación cuántica está afianzada sobre la computación clásica, especialmente todo lo que tiene que ver con el desarrollo de algoritmos, que pretende conectarla con la realidad.

Más información | Barcelona Supercomputing Center

–

La noticia

«Con MareNostrum 5 podríamos quedar entre los tres supercomputadores más rápidos del mundo, pero no es nuestro objetivo», Mateo Valero, director del BSC

fue publicada originalmente en

Xataka

por

Juan Carlos López

.